Artificial Intelligence & Machine Learning,

KI-Philosophie-Serie: Rassismus per Software

KI, Kunst und Kritik: Studierende schreiben Essays über philosophisch-ethische Fragen rund um die Künstliche Intelligenz (KI). Etwa darüber, wie die biometrische Gesichtserkennung Vorurteile und Rassenmuster untermauert. Mehr dazu in dieser sechsten Folge unserer 8-teiligen KI-Philosophie-Serie.

Von Mirko Walter, Student des Studiengangs Artificial Intelligence & Machine Learning

Die Gesichtserkennung ist eine Form Künstlicher Intelligenz. Sie bildet eine wichtige Grundlage für zahlreiche Applikationen: beispielsweise für Überwachungssysteme, Video-Konferenzen, verschiedene Mensch-Geräte-Interaktionen oder inhaltsbasierte Bilderabrufe.

Das menschliche Gesicht enthält eine Vielzahl von Informationen, die adaptive soziale Interaktionen und eine Kategorisierung demografischer Merkmale erlauben. Angesichts der Tatsache, dass Menschen bei der Gesichtswahrnehmung einen Rassen-Effekt zeigen, wird auch die Genauigkeit von Gesichtserkennungsalgorithmen untersucht.

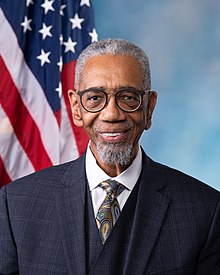

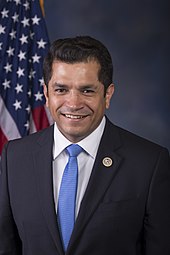

Studien haben bewiesen, dass Gesichtsidentifikations-Algorithmen Schwierigkeiten mit der korrekten Aufzeichnung dunkelhäutiger Gesichter haben. Deshalb ist es in der Entwicklung solcher Systeme schon zu fragwürdigen Vorfällen gekommen: So hat die Gesichtserkennungs-Software von Amazon beispielsweise diverse US-amerikanische Politikerinnen und Politiker fälschlicherweise mit Polizeifotos von Kriminellen abgeglichen. Dabei stellt sich die Frage, ob Gesichtserkennungs-Algorithmen rassistischen Vorurteilen (racial bias) unterliegen und wieso.

Die menschliche Kognition, die die Anhaltspunkte unserer Wahrnehmung konstruiert, ist selektiv, erlernt, kulturell geprägt, konstant und verzerrt. Das erklärt verschiedene abgespeicherte Biases über Rassen und Ethnien. Die Technologie der Gesichtserkennung arbeitet ebenfalls mit Anhaltspunkten: So benutzt sie beispielsweise die Augen als Fokalpunkt für die Vektor-Berechnung der Proportionen eines menschlichen Gesichts. Ebenso benutzt sie den Beleuchtungskontrast, um die Hautfarbe aufzuzeichnen.

Mangelnde Beleuchtung und Bildqualität verschlechtern das Ergebnis

Während Menschen wegen subjektiver Umweltfaktoren und erlernter Vorurteile zwischen Rassen und Ethnien unterscheiden, scheitern Algorithmen hingegen beispielsweise bei unzureichender Beleuchtung der Bildaufnahme oder fehlenden Fokalpunkten für die Berechnung der Proportionen. Aufgrund dieser objektiven Funktionsweise lassen sich zum Beispiel fehlerhafte Face-IDs bei interaktiven Geräten oder Videokonferenzen erklären, da die Bildqualität der Nutzenden mitwirkt.

Die menschliche Wahrnehmung ist selektiv, erlernt, kulturell geprägt und verzerrt. Die Technologie der Gesichtserkennung arbeitet auf die gleiche Weise.

Anders verhält es sich bei Sicherheitsprogrammen, die unter gleichbleibenden Bedingungen arbeiten, wie etwa bei Polizeifotos: Mehrere Forschende haben fehlerhafte Gesichtserkennung in solchen Fällen mit verschiedenen Argumenten untermauern können. Unregelmässige Verteilungsparameter, welche die Gesellschaft charakterisieren, können als datengetriebene Probleme einwirken. Oder das Problem liegt bei den Schwellenwerten oder der mangelhaften Formulierung der Kontrolle demografischer Homogenität der Nutzenden.

Das zeigt, dass der Fehler in der Konstruktion solcher Algorithmen liegt und nicht in deren Funktion. Die Tatsache, dass ein Rassenmuster bereits existiert, hindert Gesichtserkennungs-Algorithmen aber nicht daran, es Tag für Tag zu verstärken und unabhängig zur Aufrechterhaltung des Problems beizutragen.

Weiterführende Links:

- Bacchini, F., & Lorusso, L. (2019). Race, again: how face recognition technology reinforces racial discrimination

- Barmeyer, C., & Genkova, P. (2010). Wahrnehmung, Stereotype, Vorurteile

- Cavazos, J. G. et al. (2020). Accuracy comparison across face recognition algorithms

- Lin, H. J. et al. (2005). Face detection based on skin color segmentation and neural network

- Lu, X. et al. (2006). Multimodal facial gender and ethnicity identification

- Wong, Q. (2019). Why facial recognition’s racial bias problem is so hard to crack

Frage in die Runde: Wie sollen Gesichtserkennungs-Softwares von Biases befreit werden? Was fordern Sie? Bitte schreiben Sie Ihren Kommentar hier zuunterst in die Kommentarspalte.

Veröffentlicht am 30. November 2022

Lesen Sie weitere Folgen unserer KI-Philosophie-Serie:

- Folge 1: Auch Roboter brauchen Rechte

- Folge 2: Pflegeroboter dienen gut, doch ohne Herz

- Folge 3: Unfreie Roboter – unfreie Menschen

- Folge 4: Die Krux mit den rückständigen Algorithmen

- Folge 6: Rassismus per Software

- Folge 7: Im Bann der Netze

KI-Philosophie-Serie: Mirko Walter ist Student des Bachelor-Studiengangs Artificial Intelligence & Machine Learning. Er hat den obenstehenden Beitrag im Rahmen seines Studiums geschrieben. Sein Beitrag wurde geprüft und redaktionell aufbereitet. Er ist Teil einer 8-teiligen Blog-Serie mit bestbenoteten Essays von Studierenden.

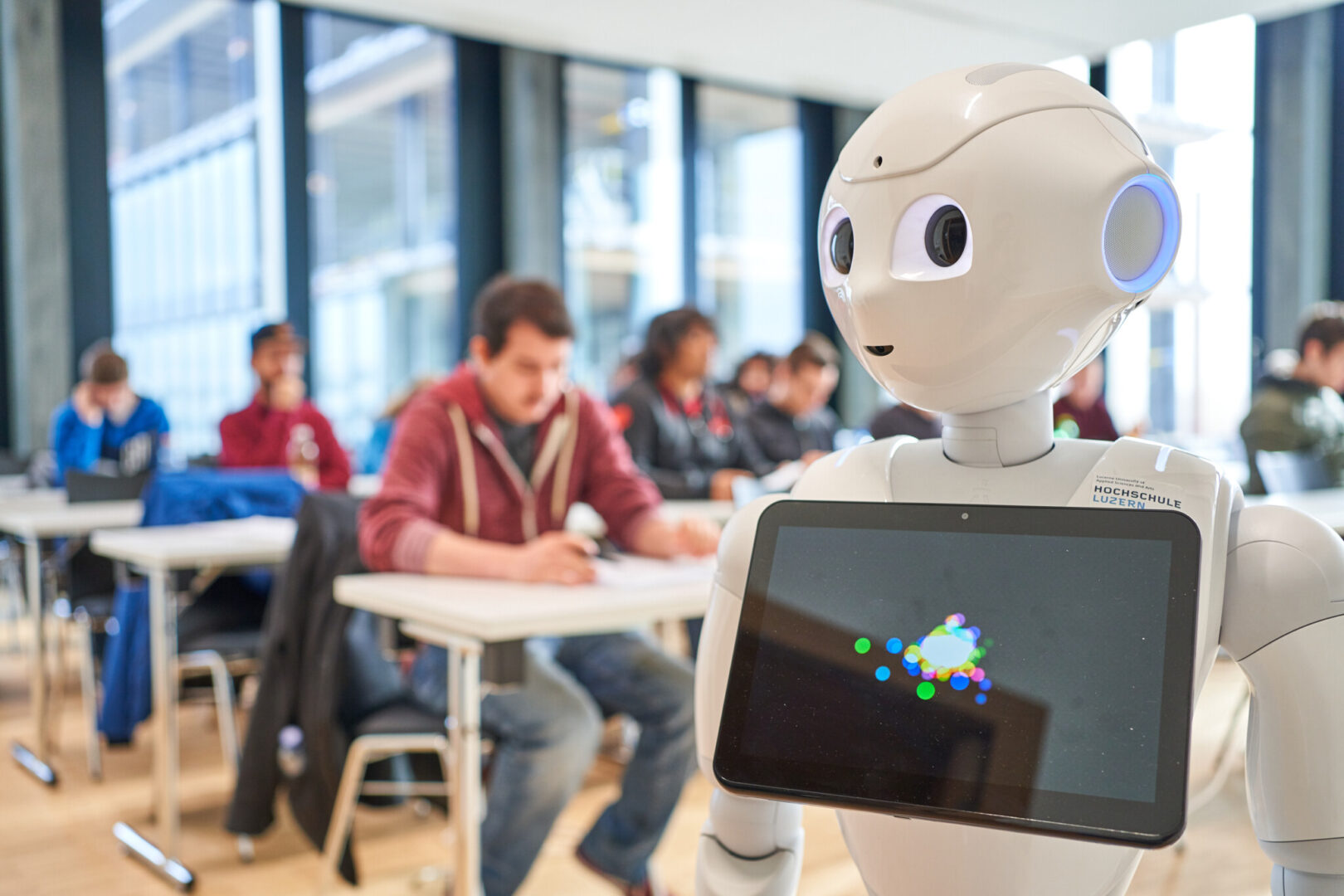

Der betreffende Studiengang nimmt die Implikation der Technik ernst. Daher lernen die Studierenden nicht nur, KI einzusetzen, sondern diese auch nachhaltig, sicher und ethisch verantwortbar umzusetzen. Als Basis dafür dient unter anderem ein Philosophie-Modul unter der Leitung von Peter A. Schmid und Orlando Budelacci. Die Hochschule Luzern setzt dabei auf Interdisziplinarität: Dieses Modul zeigt beispielhaft, wie sich drei Departemente – Informatik, Soziale Arbeit und Design & Kunst – fachübergreifend einem Zukunftsthema zuwenden.

Lesetipp: Im September 2022 erscheint Orlando Budelaccis Fachbuch «Mensch, Maschine, Identität. Ethik der Künstlichen Intelligenz» im Schwabe Verlag. Dieses Buch beleuchtet die Komplexität und Fülle der gewichtigen Umgestaltungen der Gegenwart durch die Technologie der Künstlichen Intelligenz. Es basiert auf seinen Lehrveranstaltungen und verdankt viele Anregungen den Studierenden des Bachelor-Studiengangs Artificial Intelligence & Machine Learning. Budelacci beschreibt KI als Hoffnung und Gefahr. Er setzt sich philosophisch und mit ethischen Überlegungen damit auseinander.

Lesetipp: Im September 2022 erscheint Orlando Budelaccis Fachbuch «Mensch, Maschine, Identität. Ethik der Künstlichen Intelligenz» im Schwabe Verlag. Dieses Buch beleuchtet die Komplexität und Fülle der gewichtigen Umgestaltungen der Gegenwart durch die Technologie der Künstlichen Intelligenz. Es basiert auf seinen Lehrveranstaltungen und verdankt viele Anregungen den Studierenden des Bachelor-Studiengangs Artificial Intelligence & Machine Learning. Budelacci beschreibt KI als Hoffnung und Gefahr. Er setzt sich philosophisch und mit ethischen Überlegungen damit auseinander.

Holen Sie sich einen Bachelor: Der zukunftsweisende Studiengang Artificial Intelligence & Machine Learning legt seinen Fokus auf die Schlüsseltechnologien der Künstlichen Intelligenz. Hier holen Sie sich das Rüstzeug für die steigende Nachfrage der Wirtschaft nach Fachkräften in den Bereichen Künstliche Intelligenz und Robotik. Geleitet wird der Studiengang vom langjährigen KI-Experten Donnacha Daly.

Bilden Sie sich weiter: Im CAS Digital Ethics Management lernen Sie, wie Sie mit Wertesystemen und nachhaltigen Handlungen die Digitalisierung vorantreiben. Digitale, KI-basierte und datengesteuerte Lösungen sind die Grundlage für viele Geschäftsmodelle. Das CAS bietet Werkzeuge und Methoden, um diese Lösungen nachhaltiger, sicherer und werteorientierter zu realisieren. Hier sehen Sie das Info-Video zum CAS.

Blick in die Zukunft der Künstlichen Intelligenz: Folgen Sie unserer Twitter-Seite: Dort verfolgen und kommentieren Expertinnen und Experten der Hochschule Luzern die neuesten Entwicklungen im Bereich der KI.

🚀 Besuchen Sie unsere (Online-)Info-Veranstaltungen

Über den Informatik-Blog: Hier erhalten Sie Tipps und Neuigkeiten aus der Welt der IT. Wir porträtieren Menschen und schreiben über Technologien, welche die Hochschule Luzern – Informatik mitprägen. Abonnieren Sie jetzt unseren Blog und bleiben Sie informiert.

👀 Neu: Alle Blogbeiträge und News aus unserem Department auf LinkedIn. Jetzt folgen!

Kommentare

0 Kommentare

Danke für Ihren Kommentar, wir prüfen dies gerne.