12. August 2021

Marketing- und Kommunikationsmanagement

Building Virtual Assistants (1/3) – Was Sie beachten sollten, wenn Sie einen Sprachassistenten einsetzen möchten

Ein Virtual Assistant kann die direkte Ansprechperson für Ihre Kundinnen und Kunden werden. Es lohnt sich, klein anzufangen und ein paar wesentliche Punkte zu beachten: Die Bedürfnisse der Nutzenden, den Kontext und die richtige Technologie. In drei Blogartikeln gehe ich auf diese Punkte genauer ein.

Die Virtual Assistants (VA) sind gekommen, um zu bleiben. Das heisst nicht, dass jedes Unternehmen seinen eigenen VA erstellen soll. Aber das heisst, man sollte sich mit dem Thema befassen, um den Anschluss nicht zu verpassen.

Ein wichtiger Indikator, dass eine Technologie nicht mehr ignoriert werden sollte, ist das Investitionsvolumen der grossen Konzerne: Amazon beschäftigt zum Beispiel mehr als 10’000 Entwicklerinnen und Entwickler für ihre Alexa und Google hat bereits vor vier Jahren angekündigt, dass Websites so genannten speakable content kennzeichnen sollen.

Wir können heute schon gut mit Text umgehen und auch mit Bild bzw. Video. Auch rein auditive Formate funktionieren gut, solange die Nutzenden nur zuhören müssen. Schwieriger wird es, wenn den Nutzenden zugehört werden soll, zum Beispiel wenn Suchanfragen ins Smartphone eingesprochen werden.

Bei VA geht es jedoch um die Interaktion zwischen Mensch und Maschine, was vielen Unternehmen noch schwer fällt. Es lohnt sich, schon heute zu überlegen, wie man auf dieses veränderte Nutzerverhalten reagieren möchte.

Die Technologie: Definition, Einsatzgebiete und Verbreitung

Virtual Assistants sind die Vermittler zwischen Unternehmen und den Kunden und Kundinnen. In dem Beispiel in Abbildung 1 wird der Virtual Assistant im Kundenservice eingesetzt. Es sind aber viele weitere Einsatzgebiete denkbar, bspw. zu Trainingszwecken im Human Ressource Management, als persönliche Berater von Ärzt:innen oder für den Verkauf von Tickets im Event Sales u.v.m.

Definition: Virtual Assistant

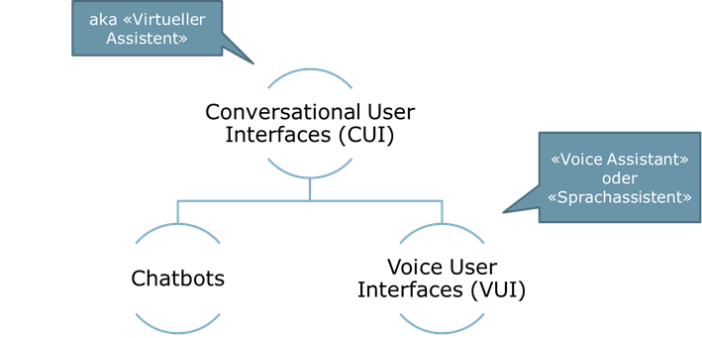

Der Virtual Assistant wird auch Conversational User Interface (CUI) genannt (siehe Abbildung 2). Denn genau das ist es: eine Konversationsschnittstelle.

Merke: Conversational User Interface > Mensch-Maschine-Kommunikation in natürlicher Sprache

«Ein virtueller Assistent ist ein Dialogsystem, das Anfragen der Benutzer beantwortet und Aufgaben für sie erledigt, in privaten und wirtschaftlichen Zusammenhängen. Er ist auf dem Smartphone ebenso zu finden wie in Unterhaltungsgeräten und in Fahrzeugen. Er versteht natürliche Sprache und wendet sie selbst an. Insbesondere bei gesprochener Sprache ist der Begriff ‘Sprachassistent’ üblich.», (Gabler Wirtschaftslektion).

Grob unterschieden werden VA in textbasierte/visuelle Dialogsysteme, so genannte Chatbots, und in auditive Dialogsysteme, so genannte Sprachassistenten (oder auch Voice Assistants). Weil so eine rein auditive Konversationsschnittstelle spezifischere Anforderungen hat, spricht man auch von Voice User Interfaces (VUI).

Verbreitung von Voice Assistants in den USA und der Schweiz

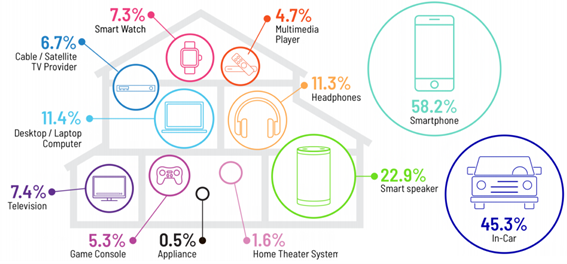

Websites, Hotlines, Brillen, Uhren oder Mikrowellen: Voice Assistants sind bereits heute überall. Die Voice Assistants werden in den USA hauptsächlich über das Smartphone und im Auto genutzt (siehe Abbildung 3).

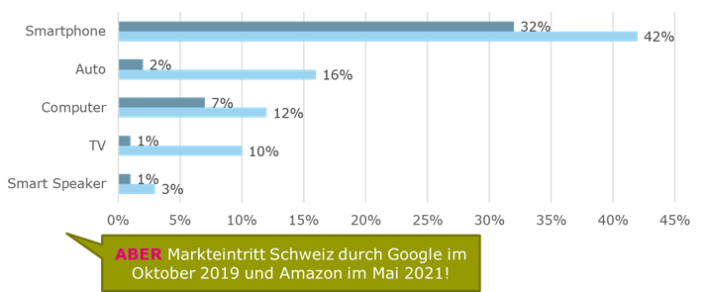

Auf dem US-amerikanischen Markt folgen an dritter Stelle die Smart Speaker. In der Schweiz folgt an dritter Stelle die Nutzung von Voice Assistants über den Computer und an vierter über den Fernseher (siehe Abbildung 4). Das hängt wesentlich mit den Geräten zusammen, die hierzulande verbreitet sind. Smart Speaker waren bis zum Zeitpunkt der Umfrage (Mitte 2019) noch gar nicht offiziell in der Schweiz käuflich.

Was ist Natural Language Processing?

VA-Technologie kommt grob in zwei Varianten vor: regelbasiert und AI-basiert. Regelbasierte VA agieren in einem klar abgegrenzten Wissensgebiet bzw. Entscheidungsraum; man spricht auch von Entscheidungsbäumen. Diese VA sind nur so «smart» wie die regelbasierten Entscheidungspfade im System programmiert und die Daten zur Synthese von Antworten verfügbar sind. Die AI-basierten VA arbeiten mit Machine Learning und können mit jeder Interaktion dazulernen. Die Antworten für die Nutzer:innen sind dadurch zwar kontextspezifisch und personalisiert, aber auch fehleranfälliger als die Antworten der regelbasierten VA.

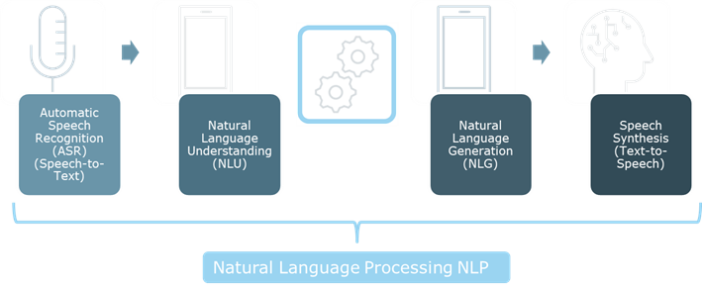

Wie Nutzende mit dem VA interagieren, hängt davon ab, wie gut es sie versteht. Das zugrunde liegende Natural Language Processing ist in Abbildung 5 skizziert.

Automatic Speech Recognition oder auch automatische Spracherkennung bezeichnet den Prozess, in dem gesprochene Sprache in Text transkribiert wird. Das funktioniert in Echtzeit, zum Beispiel mit der Diktierfunktion oder automatischer Untertitelung oder nachträglich mit Audio- oder Video-Dateien.

Mittels Natural Language Understanding (NLU) oder auch Natural Language Interpretation soll das System die Bedeutung der gesprochenen Eingabe verstehen. Für NLU müssen sich Informatik und AI-Forschung mit der Linguistik zusammenschliessen. Hilfreiche Anregungen für Conversation Designer kommen aus Disziplinen wie der Soziolinguistik, der Kommunikation und dem UX Design.

Nach der Verarbeitung des Sprachinputs wird mittel Natural Language Generation (NLG) die Antwort als Text geschrieben und anschliessend in gesprochene Sprache überführt.

Autor: Antonia Steigerwald

Kommentare

0 Kommentare

Danke für Ihren Kommentar, wir prüfen dies gerne.