KI-Philosophie-Serie: Auch Roboter brauchen Rechte

KI, Kunst und Kritik: Im Studiengang Artificial Intelligence & Machine Learning befassen sich Studierende in Essays mit philosophisch-ethischen Fragen. In dieser 8-teiligen KI-Philosophie-Serie veröffentlichen wir ihre besten Beiträge. Lesen Sie hier, weshalb das Philosophie-Modul irritiert. Und erfahren Sie im ersten Essay, warum Roboter Rechte brauchen.

Von Gabriela Bonin

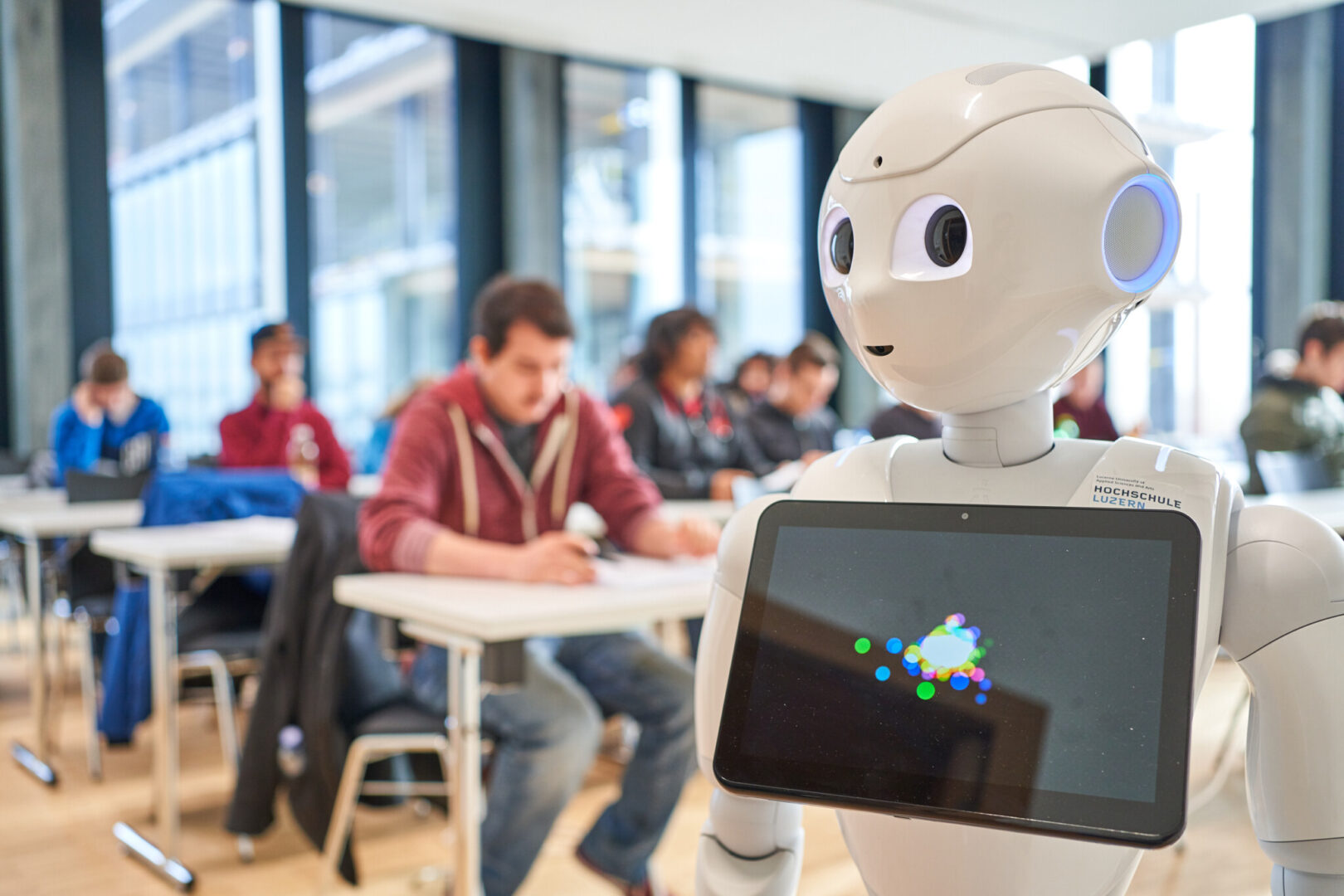

Was bedeutet die Entwicklung der Künstlichen Intelligenz (KI) für uns Menschen? Wie unterscheiden sich Mensch und Maschine? Welche technischen Utopien und Dystopien in Science-Fiction-Filmen sind beachtenswert? Ist Kunst per se rein menschlich oder ist KI-Kunst auch «echte» Schöpfung? Fragen dieser Art untersuchen Studierende des Studiengangs Artificial Intelligence & Machine Learning der Hochschule Luzern – Informatik (HSLU I) im Modul «Philosophie, Kunst und Künstliche Intelligenz».

Ich halte es für ein Qualitätsmerkmal der HSLU, dass sie sich solchen Fragen stellt.»

Peter A. Schmid, Philosophie-Dozent

Selbstverständlich ist das nur ein Teil ihrer Ausbildung. Ihr Studiengang beleuchtet vorwiegend die Schlüsseltechnologien der Künstlichen Intelligenz. Die Studierenden erwerben dabei fundiertes Fachwissen in den Bereichen Robotik, Machine Learning und Deep Learning. Das besagte Philosophie-Modul beleuchtet indes auch die gesellschaftlichen, philosophischen, künstlerischen und ethisch-normativen Fragen rund um die Künstliche Intelligenz.

Wie es dazu kam – Hintergründe zum Philosophie-Modul

Die HSLU I startete den Studiengang Artificial Intelligence & Machine Learning 2019 als ersten Bachelor-Studiengang in Machine Learning in der Schweiz. «Es war allen Verantwortlichen von Beginn an wichtig, dass dieser Studiengang die Implikation der Technik ernst nimmt», erinnert sich Peter A. Schmid, einer der Modulverantwortlichen. «Ich halte es für ein Qualitätsmerkmal der HSLU, dass sie sich solchen Fragen stellt».

Intelligenz mit Ethik koppeln

Die Studierenden sollen also lernen, wie sie KI nicht nur einsetzen, sondern diese auch nachhaltig, sicher und ethisch verantwortbar umsetzen können. Als Basis dafür dient ihnen zunächst das erwähnte Philosophie-Modul im zweiten Semester. Ab kommendem Herbst bauen sie im 5. Semester zusätzlich mit einem Ethik-Modul darauf auf.

Im vergangenen Philosophie-Modul nahmen die Modulverantwortlichen Peter A. Schmid und Orlando Budelacci die Studierenden auf ungewohnte Gedankenreisen mit. Die beiden promovierten Philosophen vereinen Fachkenntnisse aus dem Bereich Kunst, Design, Politik, Soziologie und Ethik.

Interdisziplinär arbeiten: Fachwissen aus drei Departementen vereint

Budelacci ist Vizedirektor des Departements Design & Kunst und Vorsitzender der Ethikkommission der Hochschule Luzern. Schmid doziert vorwiegend am Departement Soziale Arbeit. «Wir sind beide auch sehr an Informatik interessiert» ergänzt Schmid, dies im Gegensatz zum weit verbreiteten Vorurteil, dass Sozialwissenschaftlerinnen und Sozialwissenschaftler oft technikfeindlich seien. Die Hochschule Luzern setzt auf Interdisziplinarität – dieses Modul zeigt beispielhaft, wie sich drei Departemente fachübergreifend einem Zukunftsthema zuwenden.

Ungewöhnlich lehren und lernen

Nein, technikfeindlich sind Schmid und Budelacci nicht, aber sie regen gezielt zu kritischem Denken an. Sie haben eine andere Zugangsweise zu technischen Fragen, als es sich viele Informatikerinnen und Informatiker gewohnt sind: «Wir lehren atypisch. Unser Modul ist nicht lernzielorientiert», erklärt Schmid, «bei uns lernt man nicht mit Python programmieren oder wie man einen Bot steuert. Vielmehr denken wir gemeinsam darüber nach, welchen Einfluss diese Techniken auf unsere Welt und unser Leben haben.»

Philosophisch-ethische Überlegungen sind wichtig, weil sie die gesellschaftliche Akzeptanz der Technik sichern.

Peter A. Schmid, Philosophie-Dozent

Die Studierenden reagierten darauf sehr unterschiedlich, erzählt Schmid. Manche sagten: «Aha, das ist mal was anderes, voll interessant.» Andere wiederum seien irritiert: Denn viele seien stark auf Nutzen, Gewinnmaximierung und Effizienz ausgerichtet. Philosophische und ethische Überlegungen bringen zunächst aber keinen unmittelbaren direkten (wirtschaftlichen) Nutzen. Wie Schmid aber betont, sind ethisch-philosophische Überlegungen wichtig, «da sie die gesellschaftliche Akzeptanz der Technik sichern».

Viele Studierende seien es sich zudem aus der Mathematik oder Informatik gewohnt, dass es immer ein klares Richtig oder Falsch gebe. Eine Null oder eine Eins. Sie seien geprägt von eindeutigen Regeln, Gesetzen und Zielsetzungen.

«Herr Schmid, kommen Sie uns bloss nicht mit Heidegger!»

Im Philosophie-Modul aber gibt es oft keine Antworten. Oder viele Antworten. Wenn die Studierenden etwa Kunstwerke, Gedichte oder Musikstücke nach humanen oder künstlichen Kriterien untersuchen, fehlt ihnen dabei das Handfeste. Wenn Sie Science-Fiction-Filme wie Ex Machina oder I Robot analysieren, sind sie womöglich noch auf unterhaltende Weise gefordert.

Sollen sich die Teilnehmenden des Moduls aber überlegen, was es bedeutet, wenn dereinst die Funktionsweise des Gehirns künstlich erschaffen werden kann, dann winken doch auch etliche Studierende ab. «Herr Schmid, das ist doch völliger Schrott, kommen Sie uns nun bloss nicht noch mit Heidegger.» Derartige Aussagen hat Peter A. Schmid auch schon zu hören bekommen – in Anspielung auf den deutschen Philosophen Martin Heidegger und dessen kritische Reflexionen über die Auswirkungen der Technik auf die Welt.

Wir können die Studierenden nur zum Philosophieren einladen, wir zwingen sie nicht.

Peter A. Schmid, Philosophie-Dozent

Schmid nimmt’s gelassen. «Das finde ich völlig okay. Wir können die Studierenden nur zum Philosophieren einladen, wir zwingen sie nicht.» Sie müssen aber sehr wohl gewisse Aufgaben erfüllen: So müssen sie beispielsweise drei Essays schreiben, in denen sie sich zu frei wählbaren Themen mit ethischen, philosophischen oder politischen Fragen rund um Künstliche Intelligenz befassen.

Das macht Freude: Ausserordentliche Essays mit einer 6 benotet

Schmid und Budelacci sind von vielen dieser Texte begeistert: «Von unseren 48 Studierenden im aktuellen Studiengang haben acht die Bestnote 6 erhalten», so Schmid. Einige Beiträge seien «von ausserordentlicher Qualität».

Sind Sie neugierig darauf? Here are the winners…! Wir stellen Ihnen die Essays mit den Bestnoten in einer KI-Ethik-Serie vor.

Lesen Sie heute das erste Essay: Die Studentin Masha Grütter untersucht im folgenden Beitrag die Frage, ob Roboter Rechte benötigen. Der Beitrag wurde geprüft, redaktionell aufbereitet und ist Teil einer 8-teiligen Blog-Serie mit bestbenoteten Essays von Studierenden.

Auch Roboter brauchen Rechte

Von Masha Grütter, Studentin des Studiengangs Artificial Intelligence & Machine Learning

Was haben Mensch und Roboter gemeinsam? Zum Beispiel die Fähigkeit, zu kommunizieren. Auch haben sie beide einen Bedarf nach Schutz. Denn auch eine KI soll nicht ausgebeutet, misshandelt oder verletzt werden. Ein Essay über die Notwendigkeit von KI-spezifischen Rechten.

Artificial Intelligence (AI) – die Künstliche Intelligenz (KI) – wird in diversen Spielfilmen und Zukunftsszenarien als eine bedrohliche, superintelligente Instanz dargestellt. Sie handelt in diesen Storys heimtückisch, manipuliert die Menschen und will sie beherrschen. Sei dies im britischen Spielfilm Ex_Machina, wo die Künstliche Intelligenz Ava einen Menschen manipuliert und verletzt, um ihre Freiheit zu erlangen, oder in der britischen Science-Fiction-Serie Black Mirror, in der in diversen Zukunftsszenarien Maschinen und unter anderem auch Künstliche Intelligenzen fatale Folgen für die Gesellschaft auslösen.

Die Kernaussage ist meist dieselbe: Künstliche Intelligenz ist gefährlich und unberechenbar. Im Kontrast dazu stellt die US-amerikanische Filmproduktionsfirma Marvel Studios etwa den digitalen Hilfsassistenten J.A.R.V.I.S als hilfsbereites und sarkastisches Individuum dar.

Der US-amerikanische Film Her zeigt das Betriebssystem Samantha, welches im Verlauf der Geschichte eine physische Präsenz erlangt: Es kann reflektieren, lieben und sich weiterentwickeln.

Eines haben all diese Zukunftsvisionen gemeinsam: Sie unterschieden klar zwischen Menschen und Künstlicher Intelligenz. Das ist nach heutigem Stand noch relativ einfach. Was aber, wenn der technische Fortschritt diese Unterscheidung in Zukunft kaum noch erlauben wird? Wie ist dann noch zu unterscheiden, was ein Mensch ist und was nicht? Ist nicht auch der Mensch gefährlich, unberechenbar, herrschsüchtig und manipulativ? Und auch der Mensch sorgt sich, entwickelt sich weiter und liebt.

Böse KI? Ist der Mensch nicht auch unberechenbar, herrschsüchtig und manipulativ?

Masha Grütter

Wäre es in der Zukunft vorstellbar, einer KI Menschlichkeit, ja sogar Menschenrechte zuzusprechen? Es gibt etliche Definitionen dazu, was ein Mensch ist. Historikerinnen, Genetiker, Linguistinnen: Alle würden es wieder etwas anders definieren. Auch gibt es verschiedene Definitionen von Künstlicher Intelligenz. Somit ist es schwer, die beiden Dinge miteinander zu vergleichen – oder gar gleichzusetzen.

Was ist in Zukunft Mensch, was nicht?

Trotzdem soll dies hier versucht werden: Gehen wir also davon aus, dass es in der Zukunft möglich ist, die Funktionsweise des Gehirns künstlich zu erschaffen – so, dass neben den intellektuellen auch die emotionalen Fähigkeiten eines Menschen bei einer KI vorhanden wären. Diese künstlichen Individuen würden zudem künstliche Körper erhalten. Diese Wesen wären auf den ersten Blick optisch und auch intellektuell nicht von Menschen zu unterscheiden.

Roboter wachsen nicht im Mutterleib heran

Trotzdem gäbe es bedeutende Unterschiede: Der Mensch wächst im Mutterleib heran und wird als Säugling geboren. Er entwickelt sich vom Kleinkind zum Kind. Über die Teenagerjahre hinweg reift er zu einem erwachsenen Menschen und altert immer weiter, bis er schliesslich stirbt. Es ist unwahrscheinlich, dass Künstliche Intelligenz je eine solche Entwicklung durchlaufen wird. Die KI würde sehr wahrscheinlich als erwachsenes Individuum geschaffen werden und in diesem Zustand bleiben.

Ein nächster Unterschied ist der Körper. Der menschliche Körper ist in diversen Formen, Farben und Grössen vertreten, und trotzdem haben all diese unterschiedlichen Körper eine Gemeinsamkeit: Zellen sind die grundlegenden Bausteine für unsere physische Präsenz. Auch hier ist es wahrscheinlich, dass die Nachbildung eines Körpers für eine KI mit anderen Materialien versucht würde. Zudem können sich Mensch fortpflanzen. Auch dies ist bei der KI schwer vorstellbar.

KI pflanzt sich nicht fort, aber sie könnte neue KI bauen

Wahrscheinlicher ist es da, dass die KI neue KI bauen würde – ob dies dann als Fortpflanzung ausgelegt werden kann, ist fragwürdig. Auch ist zu vermuten, dass es zwischen den Menschen und den KI intellektuelle Unterschiede geben würde: Eine Künstliche Intelligenz hätte Zugriff auf Milliarden von Informationen – die Fähigkeit, Informationen zu speichern, ist ein Teil der Intelligenz, bei dem die KI den Menschen klar übertreffen würde.

Aus diesen Unterschieden ergeben sich auch die Gemeinsamkeiten zwischen der Künstlichen Intelligenz und den Menschen: Die gesamte Programmierung basiert auf Logik, somit kann man KI das logische Denken zusprechen. Die Fähigkeit zu kommunizieren ist bei KI wie auch beim Menschen gegeben. Auch eine gewisse «Lern»-Fähigkeit von KI spricht für deren «Menschlichkeit».

«Lernen» und kommunizieren – das haben Mensch und Maschine gemeinsam

Ein weiteres Merkmal des Menschen ist das eigenständige Denken und Handeln – auch dies könnte in Zukunft bei Künstlicher Intelligenz gegeben sein. Oft wird der Mensch auch als höchstentwickeltes Lebewesen bezeichnet. Höchstentwickelt ist die KI sicherlich auch – ob die KI ein Lebewesen ist, ist allerdings wieder fraglich. Denn gemäss Definition sind zwei der Kerneigenschaften eines Lebewesens – die Fähigkeit sich fortzupflanzen und der Aufbau aus Zellen – beides Eigenschaften, welche die KI wohl nie erreichen wird.

Somit gibt es einige Argumente dafür, dass KI als Mensch betrachtet werden könnte, und einige dagegen. Viele von ihnen sind grenzwertig. Es ist auch nicht klar, ob die Nachahmung menschlicher Eigenschaften so gut sein wird, dass diese als gleichwertig zum Menschen ausgelegt werden könnten.

Es ist noch ungewiss, ob KI je Emotionen empfinden wird

Zudem gibt es einen weiteren grossen Aspekt, der das Menschsein ausmacht: das Empfinden von Emotionen. Ob KI jemals fühlen wird, ist unklar. Wäre dies möglich, wäre es eine weitere Gemeinsamkeit. Doch was bedeutet es, Emotionen zu empfinden? Zu verstehen, was Trauer, Lust, Freude, Angst und die vielen weiteren menschlichen Empfindungen sind, bedeutet nicht, dass man sie auch tatsächlich fühlen kann. Als Aussenstehender etwas zu beobachten und zu verstehen, bedeutet nicht, dass man es auch selbst empfinden kann.

Je mehr man sich mit Menschlichkeit und Künstlicher Intelligenz auseinandersetzt, desto klarer wird, dass es viele offen Fragen gibt. Nehmen wir nun trotzdem Folgendes an: Erstens, dass der Künstlichen Intelligenz das Menschsein nicht zugesprochen würde. Zweitens, dass also in der Zukunft weiterhin klar zwischen Menschen und KI unterschieden wird. Dies sowohl in gesellschaftlicher wie auch in rechtlicher Hinsicht. Was wäre dann der nächste logische Gedankenschritt?

Nicht-Mensch-Sein soll nicht minderwertig sein

Wir kämen zum Schluss, dass Künstliche Intelligenzen nicht gleichberechtigt mit den Menschen leben, sondern als ihre Bediensteten und Untergebenen. Doch warum ist das so? Wieso wird das Nicht-Mensch-Sein mit Minderwertigkeit gleichgesetzt?

Roboter brauchen keine Menschenrechte. Vielmehr brauchen sie spezielle Recht, die auf ihre Bedürfnisse zugeschnitten sind.

Masha Grütter

Nicht-Mensch-Sein sollte nicht bedeuten, keine Rechte zu haben; diese Rechte sollten einfach anders sein als die Menschenrechte. Sie sollten auf die Bedürfnisse der Künstlichen Intelligenz zugeschnitten werden. So bräuchte die KI zum Beispiel keine speziellen Rechte für das Kindesalter, da sie dies nie durchleben würde. Trotzdem könnte es KI-Rechte geben, die sicherstellen, dass die KI nicht ausgebeutet, misshandelt oder verletzt wird. Denn sollte die KI in Zukunft ein hochentwickeltes System sein, das die gleichen Emotionen wie Menschen empfinden kann, sollte sie auch geschützt werden.

Nichtsdestotrotz ist für mich persönlich klar: Nein, Künstliche Intelligenz wird in naher Zukunft nicht mit dem Menschsein gleichgesetzt werden können. Auch wenn es viele Gemeinsamkeiten geben würde, gäbe es grundlegende Dinge, die sehr wahrscheinlich nicht gleich sein würden wie beim Menschen: die Geburt, das Erwachsenwerden und das Altern, der menschliche Körper und auch der Intellekt.

Ich distanziere mich somit klar von der Idee, eine Künstliche Intelligenz als Mensch zu betrachten. Dies heisst jedoch nicht, dass die KI minderwertig wäre. Sie wäre nur anders, und somit sollte sie auch als etwas anderes als der Mensch betrachtet werden.

Frage in die Runde: Braucht eine KI spezielle KI-Rechte? Was ist Ihnen wichtig in der digitalen Ethik? Bitte schreiben Sie Ihren Kommentar hier zuunterst in die Kommentarspalte.

Veröffentlicht am 2. August 2022

- Folge 2: Pflegeroboter dienen gut, doch ohne Herz

- Folge 3: Unfreie Roboter – unfreie Menschen

- Folge 4: Die Krux mit den rückständigen Algorithmen

- Folge 5: Ist künstliche Intelligenz intelligent?

- Folge 6: Rassismus per Software

- Folge 7: Im Bann der Netze

- Folge 8: Das Denken nicht den Suchmaschinen überlassen

Plädiert in ihrem Essay für KI-Rechte: Masha Grütter ist Studentin des Studiengangs Artificial Intelligence & Machine Learning. Sie studiert Vollzeit und wird in einem Jahr ihr Studium abschliessen.

Das Philosophie-Modul empfand sie als eine spannende Abwechslung zu den sonst hauptsächlich technischen Fächern. Sie schätzte es insbesondere, dass die komplette Thematik rund um KI im Philosophie-Modul aus ethischer Sicht hinterfragt und diskutiert wurde.

Experte für ethische Fragestellungen: Peter A. Schmid hat an der Universität Zürich Philosophie und Staatsrecht studiert. Er forscht und unterrichtet in den Bereichen ethische und normative Fragestellungen der Sozialen Arbeit sowie Ethik im Feld der Digitalisierung und der Künstlichen Intelligenz. Zusammen mit Orlando Budelacci leitet er an der Hochschule Luzern zwei Module zu Philosophie und Ethik im Bachelor-Studiengang Artificial Intelligence & Machine Learning.

Schlägt Brücken zwischen KI, Ethik und Kunst: Orlando Budelacci ist Vizedirektor der Hochschule Luzern – Design & Kunst. Er ist Vorsitzender der HSLU-Ethikkommission und Dozent im Bachelor-Studiengang Artificial Intelligence & Machine Learning. Budelacci studierte Philosophie, Kunstgeschichte und Rechtswissenschaft an der Universität Basel. 2020 absolvierte er das Oxford Artificial Intelligence Programme. Er publizierte zu Themen der politischen Philosophie, der Ethik und zur Kunst der Gegenwart.

Lesetipp: Im September 2022 erscheint Orlando Budelaccis Fachbuch «Mensch, Maschine, Identität. Ethik der Künstlichen Intelligenz» im Schwabe Verlag. Dieses Buch beleuchtet die Komplexität und Fülle der gewichtigen Umgestaltungen der Gegenwart durch die Technologie der Künstlichen Intelligenz. Es basiert auf seinen Lehrveranstaltungen und verdankt viele Anregungen den Studierenden des Bachelor-Studiengangs Artificial Intelligence & Machine Learning. Budelacci beschreibt KI als Hoffnung und Gefahr. Er setzt sich philosophisch und mit ethischen Überlegungen damit auseinander.

Lesetipp: Im September 2022 erscheint Orlando Budelaccis Fachbuch «Mensch, Maschine, Identität. Ethik der Künstlichen Intelligenz» im Schwabe Verlag. Dieses Buch beleuchtet die Komplexität und Fülle der gewichtigen Umgestaltungen der Gegenwart durch die Technologie der Künstlichen Intelligenz. Es basiert auf seinen Lehrveranstaltungen und verdankt viele Anregungen den Studierenden des Bachelor-Studiengangs Artificial Intelligence & Machine Learning. Budelacci beschreibt KI als Hoffnung und Gefahr. Er setzt sich philosophisch und mit ethischen Überlegungen damit auseinander.

Holen Sie sich einen Bachelor: Der zukunftsweisende Studiengang Artificial Intelligence & Machine Learning legt seinen Fokus auf die Schlüsseltechnologien der Künstlichen Intelligenz. Hier holen Sie sich das Rüstzeug für die steigende Nachfrage der Wirtschaft nach Fachkräften in den Bereichen Künstliche Intelligenz und Robotik. Geleitet wird der Studiengang vom langjährigen KI-Experten Donnacha Daly.

Bilden Sie sich weiter:

- Im CAS Digital Ethics Management lernen Sie, wie Sie mit Wertesystemen und nachhaltigen Handlungen die Digitalisierung vorantreiben. Digitale, KI-basierte und datengesteuerte Lösungen sind die Grundlage für viele Geschäftsmodelle. Das CAS bietet Werkzeuge und Methoden, um diese Lösungen nachhaltiger, sicherer und werteorientierter zu realisieren. Hier sehen Sie das Info-Video zum CAS.

- Mit dem CAS Machine Learning) KI verstehen, innovativ anwenden und hinter den Hype blicken! Der Kurs bietet einen fundierten Einstieg in die Algorithmen der Künstlichen Intelligenz (KI) und vermittelt grundlegendes Wissen zu allen wichtigen Teilgebieten der KI.

Blick in die Zukunft der Künstlichen Intelligenz: Folgen Sie unserer Twitter-Seite: Dort verfolgen und kommentieren Expertinnen und Experten der Hochschule Luzern die neuesten Entwicklungen im Bereich der KI.

? Besuchen Sie unsere (Online-)Info-Veranstaltungen

Über den Informatik-Blog: Hier erhalten Sie Tipps und Neuigkeiten aus der Welt der IT. Wir porträtieren Menschen und schreiben über Technologien, welche die Hochschule Luzern – Informatik mitprägen. Abonnieren Sie jetzt unseren Blog und bleiben Sie informiert.

Kommentare

1 Kommentare

Jukan Sivalingam

Ich fand den Essay von Frau Grütter sehr spannend und dies hat mich zum nachdenken angeregt

Danke für Ihren Kommentar, wir prüfen dies gerne.