ChatGPT und Microsoft Co-Pilot: So meistern Sie die damit verbundenen Herausforderungen in der Finanzbranche

Von der schnellen Textgenerierung bis zur tief integrierten KI-Lösung: Wie Banken und Versicherer ChatGPT und Co-Pilot nutzen und was Entscheider:innen darüber wissen sollten.

KI-Assistenten im Aufwind

Spätestens seit der Veröffentlichung von ChatGPT im Jahr 2022 hat generative KI Einzug in den Arbeitsalltag von Banken und Versicherungen gehalten. Mitarbeitende experimentieren mit KI-Tools, um Routineaufgaben schneller zu erledigen, sei es beim Verfassen von E-Mails, beim Erstellen von Berichten oder sogar in der Softwareentwicklung. Parallel dazu integrieren Technologiefirmen wie Microsoft solche KI-Funktionen direkt in die Bürosoftware – beispielsweise als Co-Pilot in Office-Anwendungen oder als Codierassistent in der IT. Doch was bedeutet dieser Trend konkret für die Finanzbranche? Wie unterscheiden sich einfache Tools wie ChatGPT von tief integrierten Lösungen, und worauf sollten Entscheider:innen achten? In diesem Beitrag geben wir einen Überblick über die Nutzung von ChatGPT und Microsoft Co-Pilot in Banken und Versicherungen, teilen Praxisbeispiele aus der Generative AI in Finance Studie 2024 und leiten Empfehlungen für den erfolgreichen Einstieg ab.

Generative KI im Arbeitsalltag: Überblick über die Nutzung

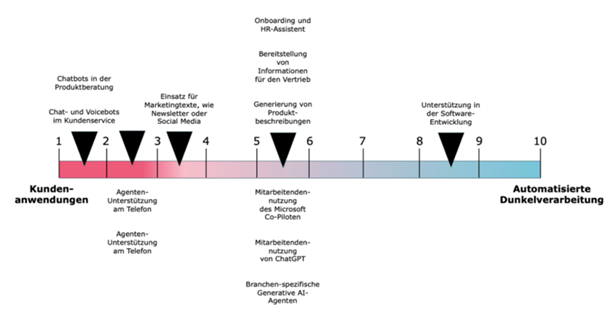

Abbildung: Die Gen AI Skala ordnet verschiedene KI-Anwendungen für Finanzinstitute auf einem Spektrum von Kundenanwendungen (links) bis zu vollautomatisierter Verarbeitung (rechts) ein. Mitarbeitendennutzung von ChatGPT und Microsoft Co-Pilot (Position 7 und 8) liegen im mittleren Bereich

Immer mehr Beschäftigte in Finanzunternehmen nutzen KI-Assistenten wie ChatGPT, um ihre Produktivität zu steigern. Laut der aktuellen IFZ Generative AI in Finance Studie 2024 verbieten fast die Hälfte der befragten Unternehmen den Mitarbeitenden die Nutzung von ChatGPT nicht grundsätzlich, geben aber klare Weisungen, etwa keine vertraulichen oder persönlichen Daten einzugeben. Statt mit Verboten setzt man auf verantwortungsvollen Umgang – freilich oft ohne Möglichkeiten zur Kontrolle, sodass an die Vernunft der Mitarbeiter appelliert wird. In der Praxis wird ChatGPT von Mitarbeitenden vor allem zur Textgenerierung eingesetzt, z. B. um Entwürfe für Schreiben oder Berichte zu erstellen. Einige nutzen es auch, um Ideen zu brainstormen oder komplexe Inhalte in einfachere Sprache zu übersetzen. Sogar zur Bildgenerierung für Präsentationen oder Marketinginhalte kommt generative KI vereinzelt zum Einsatz.

Auch Microsofts Co-Pilot-Lösungen finden ihren Weg in Unternehmen. Der Co-Pilot – oft als persönlicher KI-Assistent in Office-Anwendungen bezeichnet – wird derzeit vor allem in grösseren Organisationen (über 50 Mitarbeitende) pilotiert.

Herausforderungen: Datenschutz, IT-Integration, Schulung und Akzeptanz

Trotz aller Euphorie über ChatGPT & Co. dürfen die Herausforderungen nicht übersehen werden – gerade in der regulierten Finanzbranche. Hier die typischen Stolpersteine und wie man ihnen begegnen kann:

- Datenschutz & Compliance: Finanzunternehmen unterliegen strengen Datenschutzbestimmungen und regulatorischen Auflagen. Entsprechend zögerlich ist man, wenn es darum geht, Kundendaten oder interne Informationen in externe KI-Systeme zu geben. Viele Institute erlauben die Nutzung von ChatGPT nur unter der Auflage, keine vertraulichen Daten einzugeben. Zudem müssen neue KI-Tools mit der bestehenden IT-Governance vereinbar sein – was nicht immer der Fall ist, wenn Dienste in der Cloud gehostet werden, die Daten außerhalb der Schweiz/Europas speichern. Die Studie beobachtet, dass Sicherheits- und Datenschutzabklärungen zu KI-Services oft sehr umfassend sind und viel Zeit in Anspruch nehmen. Gerade On-Premise oder Private-Cloud-Lösungen, die für hohe Datenschutzanforderungen nötig wären, bringen technische Herausforderungen mit sich (Infrastruktur, Skalierung, Wartung). All das bremst die schnelle Einführung. Die Finanzbranche pilotiert also lieber vorsichtig, prüft und testet im kleinen Rahmen, bevor breiter ausgerollt wird.

- IT-Integration & Sicherheit: Ein KI-Assistent entfaltet seinen vollen Nutzen oft erst durch Anbindung an interne Systeme – sei es der CRM-Datenbank, dem Intranet-Wiki oder der Dokumentenablage. Doch diese Integration erfordert IT-Ressourcen und birgt Risiken. Schnittstellen müssen geschaffen, Zugriffsberechtigungen geregelt und die Systemsicherheit gewährleistet werden. Nicht selten stellt die bestehende IT-Landschaft eine Hürde dar. Legacy-Systeme sind nicht ohne Weiteres „KI-ready“ und Upgrades können teuer und zeitaufwendig sein. Hinzu kommt: Soll die KI vor Ort (on-premises) laufen, um Daten sicher im Haus zu behalten, braucht es erhebliche Rechenressourcen und Know-how im Betrieb von KI-Modellen. Die Studie verweist darauf, dass der Infrastrukturaufwand bei on-prem oder Private Cloud Implementierungen eine Herausforderung ist.

- Schulung & Change Management: Die beste KI nützt wenig, wenn Mitarbeitende sie nicht kompetent nutzenkönnen oder wollen. Aktuell gibt es in vielen Unternehmen noch wenig strukturierte Schulungen zum Thema KI-Assistenz.Teils bekommen Mitarbeitende einfach Zugang zu ChatGPT oder Co-Pilot, ohne ausführliche Einführung – Learning by Doing ist angesagt. Doch nicht jeder fühlt sich damit wohl. Einige Mitarbeiter sind unsicher im Prompting (der Kunst, die richtigen Fragen/Anweisungen an die KI zu stellen), andere stehen der Technologie skeptisch gegenüber. Hinzu kommt die Angst vor Fehlern: Was, wenn der KI-Vorschlag falsch ist? Wer haftet, wenn ein auf KI basierender Text z.B. regulatorisch heikel ist? Diese Unsicherheiten können die Akzeptanz bremsen.

- Qualität & Verantwortung: Generative KI kann beeindruckende Ergebnisse liefern, aber auch Fehler machen. Halluzinationen (plausibel klingende, aber falsche Antworten) oder ungewollte Vorurteile im Text gehören zu den bekannten Problemen aktueller Modelle. In sensiblen Bereichen – ob Kundenkommunikation oder Programmieren einer Bankensoftware – darf man KI-Ausgaben daher nie ungeprüft übernehmen. Unternehmen müssen sicherstellen, dass immer ein Mensch die letzte Kontrolle behält, bis ein Ergebnis „rausgeht“. Das bedeutet im Umkehrschluss: Vollautomatisierung ist (noch) selten sinnvoll; eher spricht man von Human-in-the-Loop-Konzepten. Bei Unite etwa übernimmt die KI nie den Serviceprozess vollständig, sondern steht beratend zur Seite, während die Mitarbeiter die Prozessverantwortung behalten. Bei PensionDynamics wird jeder von Co-Pilot vorgeschlagene Code von einem zweiten Entwickler geprüft, bevor er ins Produkt fliesst. Solche Mechanismen sind essenziell, um Qualität und Compliance zu gewährleisten.

Empfehlungen für Entscheider:innen: So gelingt der KI-Einstieg

Wie können Bank- und Versicherungsentscheider nun konkret vorgehen, um KI-Assistenten wie ChatGPT und Co-Pilot sinnvoll einzuführen? Basierend auf den Studienergebnissen und Praxisbeispielen lassen sich einige Empfehlungen ableiten:

- Klein anfangen und experimentieren: Starten Sie mit Pilotprojekten in isolierten Bereichen, um Erfahrung zu sammeln. Identifizieren Sie Aufgaben mit hohem Potenzial (z. B. interne Textentwürfe, Protokollzusammenfassungen oder Code-Reviews) und lassen Sie ein kleines Team ChatGPT oder Co-Pilot unter realen Bedingungen ausprobieren. Durch solche Experimente steigt das Verständnis für die Möglichkeiten und Grenzen der KI. Die Studie zeigt, dass Banken und Versicherer bereits fleissig pilotieren und testen, wobei das Interesse am Einsatz von Generative AI mit jeder Erfahrung wächst. Nutzen Sie diese Lernphase, um Use Cases zu verfeinern und eventuell notwendige Richtungsänderungen frühzeitig vorzunehmen, bevor eine breite Ausrollung erfolgt.

- Datenschutz frühzeitig klären und das richtige Setup wählen: Bevor KI-Tools in der Breite eingesetzt werden, sollten die Compliance-Hausaufgaben gemacht sein. Führen Sie eine Datenschutzprüfung durch: Welche Daten dürfen in eine Cloud-Lösung fliessen? Brauchen wir eine On-Premise-Variante? Je nach Ergebnis wählen Sie die passende technische Lösung. Die Studie betont, dass es unabdingbar ist, Datenschutz und regulatorische Anforderungen zu berücksichtigen und ein entsprechendes KI-Setup zu wählen. Ggf. kann das bedeuten, auf Lösungen wie Azure OpenAI (mit Datenhaltung in Europa) zu setzen oder – falls verfügbar – nationale Clouds oder eigene Modellinstanzen zu verwenden. Wichtig sind auch interne Richtlinien: Legen Sie schriftlich fest, wie Mitarbeitende die Tools nutzen dürfen. Ein Beispiel aus der Praxis: Helvetia hat intern transparent gemacht, wie und wofür ChatGPT genutzt wird und was das für Datenschutz und Nutzungsbedingungen bedeutet – dadurch wissen Mitarbeitende genau, woran sie sind.

- Mitarbeitende befähigen und einbinden: Der Erfolgsfaktor Nummer eins bei der Einführung neuer Technologien sind die Menschen, die damit arbeiten. Planen Sie Schulungs- und Change-Massnahmen von Beginn an mit ein. Bieten Sie Trainings (Präsenz oder E-Learning) zu den KI-Tools an – von allgemeinen Einführungen bis zu spezifischen Workshops für bestimmte Abteilungen. Derzeit gibt es laut Studie kaum strukturierte Einführungen; viele verlassen sich auf Learning by Doing. Hier können Sie positiv herausstechen, indem Sie Ihre Mitarbeitenden aktiv auf die Reise mitnehmen. Identifizieren Sie früh KI-Enthusiasten in Ihrem Haus, die als Multiplikatoren fungieren können. Diese können als KI-Botschafter Kolleg:innen unterstützen und Anwendungsfälle vorantreiben. Beziehen Sie ausserdem die Endanwender in Pilotphasen ein: Die KPT hat beispielsweise kontinuierlich Mitarbeitende in das Testing ihres Chatbot-Agenten involviert und wertvolles Feedback erhalten. Solche Einbindung schafft Akzeptanz, weil sich niemand übergangen fühlt, und verbessert gleichzeitig das Ergebnis. Last but not least: Nehmen Sie der Belegschaft die Angst. Erklären Sie, dass KI-Assistenten unterstützensollen und nicht die Menschen ersetzen. Feiern Sie kleine Erfolge (z. B. „Mit Co-Pilot haben wir das letzte Release 20% schneller geschafft – Dank an das Team!“) und teilen Sie Erfahrungsberichte. Die KPT hat mit ihrem internen GenAI-Podcast einen Weg gefunden, die Mitarbeitenden laufend über KI-Neuerungen zu informieren und damit Interesse und Know-how zu fördern.

- Klare Verantwortlichkeiten und Kontrollmechanismen definieren: Legen Sie fest, wie die Qualitätskontrollebei KI-gestützten Prozessen erfolgt. Zum einen braucht es für jeden Use Case einen Verantwortlichen, der die Entscheidungen trifft, was mit KI automatisiert bzw. vorgeschlagen wird und der die Ergebnisse im Blick behält. Zum anderen sollten KI-Ausgaben geprüft werden, bevor sie Wirksamkeit entfalten. Implementieren Sie z. B. ein Vier-Augen-Prinzip. Kommunizieren Sie intern deutlich: Die Verantwortung bleibt beim Menschen. Die KI mag empfehlen – die Entscheidung trifft weiterhin der Mitarbeiter bzw. die Mitarbeiterin. Dieses Prinzip der menschlichen Kontrolle schützt vor Fehlern und stärkt zugleich das Vertrauen in die neuen Tools.

Fazit und nächste Schritte

Generative KI wie ChatGPT und Microsoft Co-Pilot entwickelt sich rasant vom Trendthema zur praktischen Anwendung – auch in der Finanzbranche. Zahlreiche Beispiele zeigen, dass sich mit KI-Unterstützung Prozesse beschleunigen, Services verbessern und sogar neue Geschäftsansätze finden lassen. Gleichzeitig gilt es, die besonderen Anforderungen von Banken und Versicherern zu berücksichtigen, insbesondere in Bezug auf Datenschutz und Regulierung. Entscheider:innen sind gefordert, Chancen und Risiken sorgfältig abzuwägen und ihrem Haus einen Leitfaden für den sinnvollen KI-Einsatz an die Hand zu geben. Wer heute proaktiv Experimente wagt, seine Mitarbeitenden mitnimmt und aus Pilotprojekten lernt, verschafft sich einen Vorsprung – in Effizienz und Innovation.

Möchten Sie selbst tiefer in das Thema einsteigen und praxisnah lernen, wie Sie KI-Assistenten erfolgreich einführen? Dann nutzen Sie unsere Weiterbildungsangebote! Melden Sie sich zum Fachkurs Artificial Intelligence in Banking an oder besuchen Sie das Seminar „Co-Pilot für Versicherer“, um von Expertenwissen und Best Practices zu profitieren.

*Dieser Text wurde mit ChatGPT 4o DeepResearch geschrieben. Als Quelle diente ausschliesslich die neusten Generative AI in Finance Studie des IFZ. Zudem wurde der Text von den Mitarbeitenden der HSLU auf inhaltliche, sachliche und sprachliche Richtigkeit geprüft. Nötige Anpassungen wurden durch Kollegen des IFZ vorgenommen.